深度好文 | 机器智能的安全之困 技术开发中的伦理与挑战

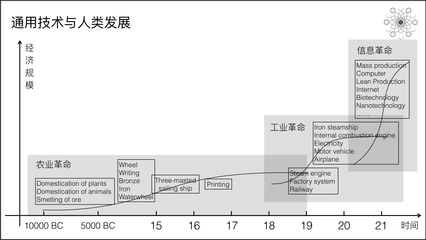

在计算机信息科技领域,机器智能的技术开发正以前所未有的速度推进,从自动驾驶到智能医疗,从金融风控到内容创作,AI技术已深度融入社会生活的各个层面。伴随着技术能力的指数级增长,机器智能的安全之困日益凸显,成为开发者、研究者和政策制定者必须直面的核心议题。

一、技术本身的安全脆弱性

机器智能系统,尤其是基于深度学习的模型,其决策过程常被视为“黑箱”,缺乏足够的透明度和可解释性。这种不透明性不仅可能导致难以察觉的偏见与歧视(如招聘算法中的性别歧视、信贷评估中的种族偏见),更可能被恶意利用。对抗性攻击能够通过微小的、人眼难以察觉的输入扰动,轻易欺骗图像识别系统;数据投毒攻击则能在训练阶段植入后门,导致模型在特定触发条件下输出错误或危险的结果。这些技术层面的安全漏洞,使得高度依赖AI的关键基础设施(如电网、交通系统)面临潜在风险。

二、数据隐私与滥用的伦理深渊

机器智能的“燃料”是海量数据。在开发过程中,对个人数据的收集、使用与存储,时刻游走在隐私保护的边缘。未经充分脱敏的数据泄露、超出用户授权的数据二次利用、基于用户画像的精准操控(如信息茧房、成瘾性设计),都将个体置于“全景监控”之下。如何在技术创新与数据隐私保护之间找到平衡,是开发过程中无法回避的伦理拷问。欧盟的《通用数据保护条例》(GDPR)等法规的出台,正是对数据滥用乱象的回应,也为技术开发划定了法律红线。

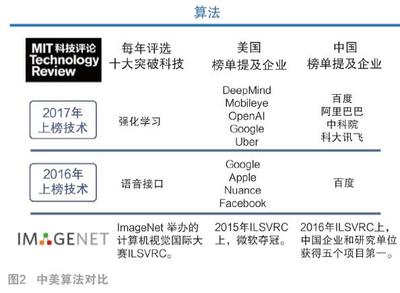

三、算法偏见与社会公平的冲突

算法并非绝对客观。它们学习自人类社会产生的数据,因此不可避免地会继承甚至放大历史数据中存在的偏见与不公。当这些带有偏见的算法被应用于司法量刑、社会福利分配、教育机会筛选等领域时,可能系统性边缘化特定群体,固化甚至加剧社会不平等。技术开发者的责任,已不仅仅是实现功能,更包括对训练数据进行审慎清洗、对算法决策进行公平性评估,并建立纠偏与问责机制。

四、自主系统的失控风险与责任归属

随着智能体自主性的提高,从预编程规则走向基于目标的自主决策,失控风险随之增加。当自动驾驶汽车在不可避免的事故中做出“电车难题”式的选择,当自主武器系统错误识别目标造成平民伤亡,责任应由谁承担?是开发者、制造商、运营商,还是算法本身?现有的法律与责任框架在应对高度自主的机器智能时显得力不从心。这要求技术开发必须与安全设计(Safety by Design)、伦理框架及前瞻性立法同步进行。

五、应对之策:走向负责任的技术开发

破解机器智能的安全之困,需要多管齐下,构建全方位的治理体系:

- 技术层面:大力发展可解释AI(XAI)、联邦学习、同态加密等技术,增强透明度、保护数据隐私;将安全与鲁棒性测试贯穿开发全周期。

- 标准与规范层面:行业组织与标准机构需加快制定AI安全、伦理与质量评估的行业标准与最佳实践。

- 治理与监管层面:建立跨学科、多元参与的治理框架,发展“适应性治理”,使监管既能防范风险,又不扼杀创新。

- 人才与文化层面:在技术教育中深度融合伦理课程,培养开发者的责任意识,在科技企业文化中树立“负责任创新”的核心价值观。

机器智能的技术开发,已行至一个关键的历史十字路口。它带来的福祉是巨大的,但其潜在的安全与伦理风险同样不容小觑。安全之困并非技术发展的终点,而是迈向更成熟、更负责任、更以人为本的智能时代的必经考验。唯有将安全、伦理与公平深度嵌入技术开发的基因,以审慎的乐观与持续的努力构建信任,我们才能真正驾驭智能之力,确保其为全人类创造一个更安全、更美好的未来。

如若转载,请注明出处:http://www.ekejtezgpwl.com/product/69.html

更新时间:2026-05-08 10:57:55